El libro de Kanerva desapareció de la vista y la propia estrella de Hofstadter se apagó, excepto cuando ocasionalmente levantaba la cabeza para criticar un nuevo sistema de inteligencia artificial. En 2018, escribió sobre Google Translate y tecnologías similares: “Todavía falta algo profundamente en el enfoque, que se traduce en una sola palabra: comprensión.” Pero el GPT-4, lanzado en 2023, produjo el momento de conversión de Hofstadter. “Me sorprenden algunas de las cosas que hacen los sistemas”, me dijo recientemente. “Esto habría sido inconcebible hace apenas diez años.” El deflacionista más ferviente ya no podía deflactar. He aquí un programa que supo traducir como experto, hacer analogías, improvisar, generalizar. ¿Quiénes éramos nosotros para decir que no entendía? “Hacen cosas que se parecen mucho a pensar”, dijo. “Se podría decir que ellos son pensando, sólo que de una manera un tanto extraña.

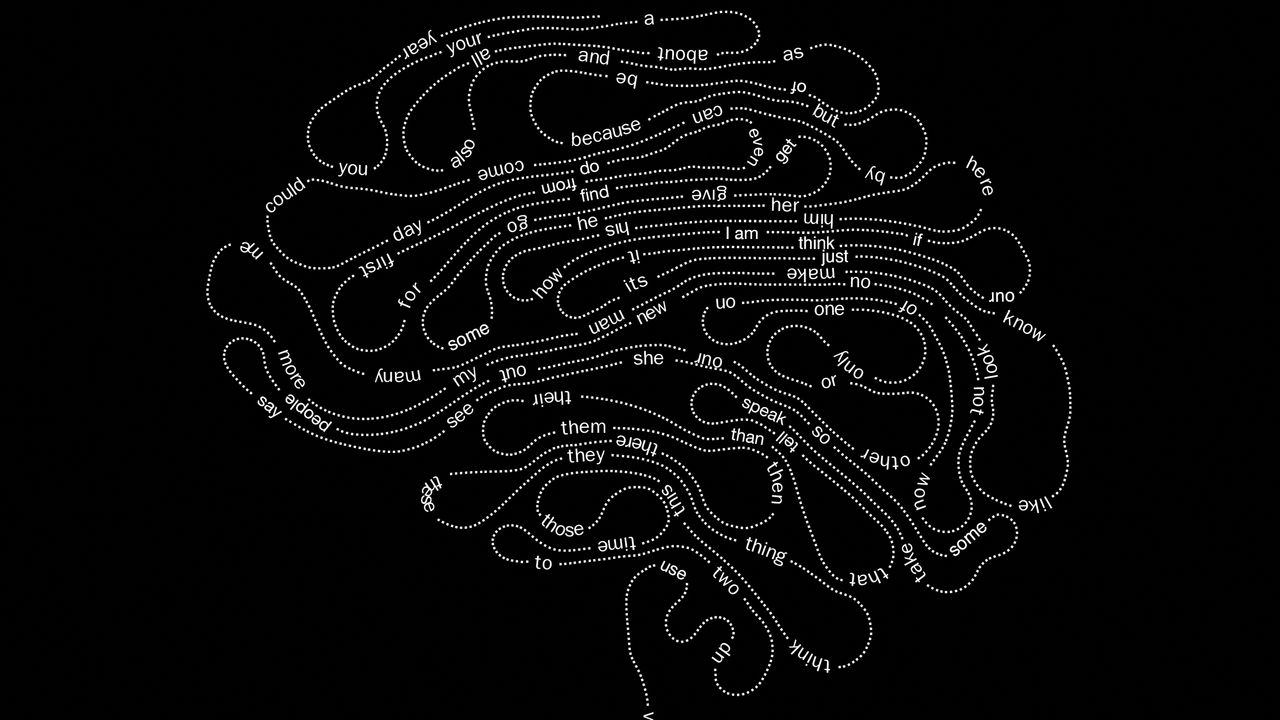

Los LLM parecen tener dentro de ellos una máquina de “ver como”. Representan cada palabra mediante una serie de números que indican sus coordenadas (su vector) en un espacio de alta dimensión. En GPT-4, un vector de palabras tiene miles de dimensiones, que describen sus matices de similitud y diferencia con todas las demás palabras. Durante el entrenamiento, un modelo de lenguaje grande cambia las coordenadas de una palabra cada vez que comete un error de predicción; Las palabras que aparecen juntas en los textos están muy juntas en el espacio. Esto produce una representación increíblemente densa de usos y significados, en la que la analogía se convierte en una cuestión de geometría. En un ejemplo clásico, si toma la palabra vector para “París”, resta “Francia” y luego agrega “Italia”, el otro vector más cercano será “Roma”. Los LLM pueden “vectorizar” una imagen codificando lo que contiene, su estado de ánimo e incluso las expresiones faciales de las personas, con suficiente detalle como para volver a dibujarla en un estilo particular o escribir un párrafo sobre ella. Cuando Max le pidió a ChatGPT que lo ayudara con el aspersor del parque, el modelo no solo estaba enviando mensajes de texto. La fotografía de las tuberías se comprimió, a instancias de Max, en un vector que capturó sus características más importantes. Este vector sirvió como dirección para llamar palabras y conceptos cercanos. Estas ideas, a su vez, llevaron a otras a medida que el modelo proporcionaba información sobre la situación. Escribió su respuesta con estas ideas “en mente”.

Hace unos meses, leí una entrevista con un investigador antrópico, Trenton Bricken, que trabajó con colegas para sondear el interior de Claude, la serie de modelos de IA de la compañía. (Su investigación no ha sido revisada por pares ni publicada en una revista científica). Su equipo identificó conjuntos de neuronas artificiales, o “características”, que se activan cuando Claude está a punto de decir una cosa u otra. Las funciones resultan ser como botones de volumen para conceptos; Móntalos y el modelo hablará de poco más. (En una especie de experimento de control del pensamiento, se mostró el elemento que representa el puente Golden Gate; cuando un usuario le pidió a Claude una receta de pastel de chocolate, los ingredientes sugeridos incluían “1/4 taza de niebla seca” y “1 taza de agua de mar tibia”). En la entrevista, Bricken mencionó la arquitectura Transformer de Google, una receta para construir redes neuronales que sustentan los principales modelos de IA. (La “T” en ChatGPT significa “Transformar”). Argumentó que las matemáticas en el corazón de la arquitectura Transformer se aproximaban mucho a un modelo propuesto décadas antes, por Pentti Kanerva, en “Sparse Distributed Memory”.

¿Debería sorprendernos la correspondencia entre la IA y nuestro propio cerebro? Después de todo, los LLM son redes neuronales artificiales que psicólogos y neurocientíficos ayudaron a desarrollar. Lo que es más sorprendente es que cuando los modelos practicaron algo de memoria (predecir palabras) comenzaron a comportarse de una manera similar a la del cerebro. Hoy en día, los campos de la neurociencia y la inteligencia artificial están entrelazados; Los expertos en cerebro utilizan la IA como una especie de organismo modelo. Evelina Fedorenko, neurocientífica del MIT, ha utilizado LLM para estudiar cómo el cerebro procesa el lenguaje. “Nunca pensé que sería capaz de pensar en este tipo de cosas en mi vida”, me dijo. “Nunca pensé que tendríamos modelos lo suficientemente buenos”.

Se ha vuelto común decir que la IA es una caja negra, pero podría decirse que es todo lo contrario: un científico puede investigar la actividad de neuronas artificiales individuales e incluso modificarlas. “Tener un sistema funcional que ejemplifique una teoría de la inteligencia humana: ese es el sueño de la neurociencia cognitiva”, me dijo Kenneth Norman, neurocientífico de Princeton. Norman creó modelos informáticos del hipocampo, la región del cerebro donde se almacenan los recuerdos episódicos, pero en el pasado eran tan simples que sólo podía darles aproximaciones aproximadas de lo que podría caber en la mente humana. “Ahora puedes dar modelos de memoria con los estímulos exactos que le das a una persona”, dijo.