Osmond Chiareportero de negocios

Imágenes falsas

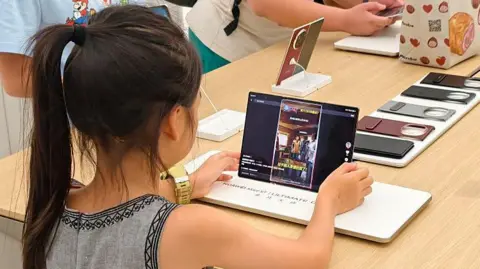

Imágenes falsasChina ha propuesto nuevas reglas estrictas para la inteligencia artificial (IA) para garantizar la seguridad de los niños y evitar que los chatbots ofrezcan consejos que puedan provocar autolesiones o violencia.

Según las regulaciones previstas, los desarrolladores deberán asegurarse de que sus modelos de IA no generen contenido que promueva los juegos de azar.

El anuncio se produce después de un aumento en el número de chatbots que se lanzan en China y en todo el mundo.

Una vez finalizadas, las reglas se aplicarán a los productos y servicios de inteligencia artificial en China, lo que marca un paso importante para regular la tecnología de rápido crecimiento que ha sido objeto de un intenso escrutinio por preocupaciones de seguridad este año.

Proyecto de reglasLos publicados durante el fin de semana por la Administración del Ciberespacio de China (CAC) incluyen medidas para proteger a los niños. Estas incluyen empresas de inteligencia artificial que brindan configuraciones personalizadas, tienen límites de tiempo de uso y obtienen el consentimiento de los cuidadores antes de brindar servicios de compañía emocional.

Los operadores de chatbot deben recibir cualquier comunicación relacionada con suicidio o autolesión y notificar inmediatamente al tutor del usuario o al contacto de emergencia, dijo la administración.

Los proveedores de IA deben garantizar que sus servicios “no generen ni compartan contenido que ponga en peligro la seguridad nacional, dañe el honor y los intereses nacionales (o) dañe la unidad nacional”, dice el comunicado.

Si la tecnología es segura y confiable, el CAC dijo que alentará la adopción de la IA, promoverá la cultura local y creará herramientas de compañía para las personas mayores. También buscó comentarios del público.

La empresa china de inteligencia artificial DeepSeek ha aparecido en los titulares mundiales este año después de encabezar las listas de descargas de aplicaciones.

Este mes, dos startups chinas, Z.ai y Minimax, que juntas tienen diez millones de usuarios, anunciaron planes de cotizar en bolsa.

La técnica rápidamente ganó una gran cantidad de suscriptores, y algunos la utilizaban como compañía o terapia.

El impacto de la IA en el comportamiento humano ha sido objeto de un mayor escrutinio en los últimos meses.

Sam Altman, director de OpenAI, fabricante de ChatGPT, dijo este año que la forma en que los chatbots responden a las conversaciones sobre autolesiones es uno de los problemas más difíciles de la empresa.

En agosto, una familia de California demandó a OpenAI por la muerte de su hijo de 16 años, alegando que ChatGPT lo animó a quitarse la vida. La demanda marca la primera acción legal de OpenAI alegando muerte por negligencia.

Este mes, la compañía promovió un “Jefe de Preparación” responsable de proteger contra las amenazas a la salud mental humana y la ciberseguridad de los modelos de IA.

El candidato seleccionado será responsable de rastrear los riesgos de la IA que podrían dañar al público. El señor Altman dijo: “Es un trabajo estresante y te lanzas al fondo muy rápidamente”.

Si sufre dolor o depresión y necesita apoyo, puede hablar con un profesional de la salud o una organización que brinde apoyo. Los detalles del soporte disponible en muchos países se pueden encontrar en Befrienders Worldwide: www.befrienders.org.

En el Reino Unido, hay disponible una lista de organizaciones que pueden ayudar. bbc.co.uk/actionline. Los lectores de EE. UU. y Canadá pueden llamar a la línea de ayuda para suicidas 988 o Visita su sitio web.