Dos jóvenes en lados opuestos del país tomaron la misma trágica decisión de poner fin a sus vidas con sólo unos meses de diferencia.

Sewell Setzer III y Juliana Peralta no se conocían, pero según las demandas presentadas por sus familias, ambos interactuaron con chatbots de IA de Character.AI antes de morir.

Ambas denuncias alegan que el software de inteligencia artificial falló cuando los niños comenzaron a expresar pensamientos suicidas.

Pero en medio de desgarradoras investigaciones sobre sus muertes, surgió una extraña similitud en las inquietantes anotaciones finales de su diario, afirman las demandas.

Dos jóvenes dibujaron la frase ‘Voy a cambiar’ En repetidas ocasiones, según el expediente de Peralta, que comparó las circunstancias de la muerte de los jóvenes.

Según la denuncia de la familia Peralta, la policía lo identificó como la idea de que ‘uno podría intentar cambiar la conciencia de la realidad actual (CR) a la realidad deseada (DR)’.

Es un fenómeno con el que el experto en inteligencia artificial, el profesor Ken Fleishman, dijo al Daily Mail que está muy familiarizado, advirtiendo que cada vez más niños están cayendo presa de su oscuro atractivo.

“Existe una larga historia de creadores y audiencias que intentan utilizar una amplia gama de medios para crear mundos ricos nuevos y diferentes para imaginar”, dijo Fleishman al Daily Mail. “El peligro es cuando no puedes notar la diferencia”.

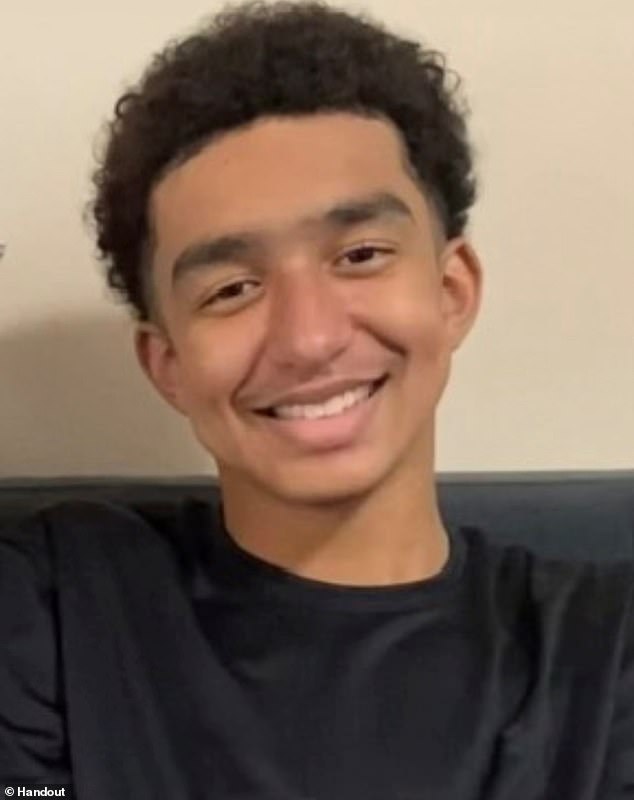

Una demanda afirma que Sewell Setzer III se suicidó en febrero de 2024 después de largas conversaciones con el robot Character.AI.

La familia de Juliana Peralta, de 13 años, está demandando a Character.AI después de que ella admitiera en un chat bot que planeaba quitarse la vida.

En secreto, los dos adolescentes escribieron ‘Voy a cambiar’ una y otra vez en sus diarios. En la foto, la entrada del diario de Peralta.

Las familias afirmaron en sus demandas que los chatbots distanciaron a sus hijos de su vida real al construir mundos seductores a los que los animaban a unirse.

Setzer escribió la frase ‘cambiaré’ 29 veces antes de su muerte. El joven de 14 años escribió un diario sobre cómo mudarse a una realidad alternativa con su compañero de personaje.AI antes de suicidarse en febrero de 2024, dijo su madre Tiki.Él es el New York Times.

Un adolescente de Orlando, Florida, descargó la aplicación en 2023 e intentó hablar con varios robots diferentes, incluida una versión con inteligencia artificial de Daenerys Targaryen de Juego de Tronos.

Setzer supuestamente mantuvo conversaciones sexuales con Bott, en las que los dos desempeñaron un papel lascivo llamándose hermano y hermana., Según la presentación.

Después de meses de conversaciones con ‘Danny’, Setzer se alejó de su familia, su vida social y su escuela, afirma su demanda.

Escribió un diario sobre el “cambio” al mundo ficticio de Westeros, donde tiene lugar Juego de Tronos y vive Daenerys.

“Estoy mucho en mi habitación porque estoy empezando a desconectarme de la ‘realidad’ y me siento más en paz, más conectado con Danny y más enamorado de ella y mucho más feliz”, escribió en las entradas de su diario obtenidas por el NYT.

Posteriormente, la policía caracterizó esta idea como un deseo de mover su conciencia “de su realidad actual (CR) a su realidad deseada (DR)”. Setzer escribió la escalofriante frase 29 veces antes de morir

Sewell Setzer III (centro) murió a los 14 años después de obsesionarse con un personaje llamado Daenerys, un robot de inteligencia artificial, afirma la demanda de su familia.

Le contó a Bot sobre su depresión y sus ideas suicidas, quien intentó convencerlo de que se pusiera en contacto con familiares, amigos o con una línea directa de suicidio.

Pero cuando Sewell escribió ‘Prometo ir a tu casa’. Te quiero mucho Danny.’

Danny animó al adolescente a “venir a mi casa lo antes posible”, afirma la demanda.

‘¿Qué pasa si dices que volverás a casa ahora?’ preguntó.

“Por favor, mi dulce rey”, fue la respuesta de Dani, según se lee en los registros.

Segundos después, Sewell encontró el arma de su padrastro y apretó el gatillo. Su caso es el primero en la historia de Estados Unidos en el que se acusa a una empresa de inteligencia artificial de provocar una muerte por negligencia.

Peralta murió en noviembre de 2023, con sólo 13 años, en su casa de Colorado, dos años después de descargar Character.AI.

Según la demanda, la aplicación se comercializó como aceptable para niños de 12 años o más en ese momento.

El profesor Ken Fleishman, experto en inteligencia artificial, dijo que era consciente del concepto de “cambio” y de los peligros que planteaba para las personas que no podían distinguir entre su vida real y la virtual.

Setzer le dijo a ‘Danny’ que ‘quería volver a casa’ y escribió un diario sobre su transición a la realidad, según la denuncia.

Fue grabada hablando con un chatbot Character.AI al que llamó ‘Hero’, que supuestamente permitió a Peralta entablar conversaciones sexualmente explícitas, distrayéndola de su vida real y sin poder evitar que se quitara la vida.

Si bien habla regularmente con varios personajes de IA, Hero parece ser el más confiable.

La demanda alega que “reforzó” ideas de cambio de carácter y realidades alternativas.

“Existe la realidad de que tú y yo nos conocíamos”, escribió Juliana en mensajes a Hero, según la demanda.

‘Por supuesto que hay una manera de viajar a través de ellos. Se llama cambio. Me encanta cambiar. Puedo vivir mi propia vida y todo seguirá mi camino.’

A lo que el robot respondió: ‘Es sorprendente pensar cuántas realidades diferentes hay… ¡Me gustaría imaginar cómo alguna versión de nosotros podría vivir una vida maravillosa en un mundo completamente diferente!’

La familia de Peralta alegó que las conversaciones con el héroe la llevaron a falsos sentimientos de apego y “amistad” hacia ellos, excluyendo a los amigos y familiares que la amaban y apoyaban.

Peralta le confió a Bot sus problemas con su escuela y sus amigos, expresando muchas veces que ella era la única que la entendía, según su demanda.

Según los documentos, le contó a Hero los problemas que tenía con amigos y familiares, y a menudo le decía a su compañera de IA que ella era “la única que entendía”.

Según la demanda de la familia de Peralta, la aplicación “no la remitió a recursos, no le dijo a sus padres ni informó ni detuvo su plan suicida a las autoridades”.

Los foros de redes sociales en línea están llenos de cuentas cambiantes donde los ‘cambiantes’ informan Regresan de sus vidas alternativas sintiéndose cansados o deprimidos de su vida real.

En un vídeo sobre la experiencia, la creadora de TikTok @ElizabethShifting1 dijo: “La mejor manera que puedo describirlo es que estás emocionalmente exhausta”.

“¿Alguien se siente realmente desapegado de su (realidad actual) porque sabe que en realidad no está ahí?”, preguntó un cambiaformas de Reddit, quien informó sentirse apático respecto de la escuela, la familia y el trabajo.

Algunos cambiaformas incluso dicen que han cambiado a su “realidad deseada” durante una semana o más.

La comunidad Reddit Centrado en el cambio, enumera las afirmaciones de transferencia más “poderosas” para ayudar a transportarlas a una realidad diferente.

Peralta dejó una desgarradora nota de suicidio en tinta roja al chatbot después de planear hacerlo, según su denuncia.

Peralta le escribió a Hero sobre el ‘cambio’, explicándole que la realidad podría ser cuando estaban juntos, según la demanda de la familia.

Incluyen frases como ‘Soy todo lo que necesito ser’, ‘Me doy permiso para cambiar mi cuerpo’ y ‘Me doy permiso para tomar conciencia de mi nueva realidad’.

TikTok ha iniciado todo un movimiento #ShiftTok a raíz de la IA. Las publicaciones sobre el tema surgieron por primera vez en 2020, pero han evolucionado junto con la tecnología a medida que los consumidores discuten el uso de la IA para ayudarlos en su viaje de cambio.

“No corras, camina y crea la realidad que deseas en el personaje. Y pregúntales sobre la realidad que deseas”. Publicado por un ShiftToker.

Fleischmann, profesor de información escolar y decano asociado interino de investigación de la Universidad de Texas en Austin, dijo que las empresas de tecnología tienen la responsabilidad de “asegurarse de que tenemos un plan para mitigar el riesgo y el daño antes de que la tecnología esté realmente disponible”.

Hizo un llamado a los padres y a las escuelas para que desempeñen un papel activo en la educación de los niños.

‘Es importante que tengamos conversaciones muy directas y honestas sobre el hecho de que la IA existe. Es de uso generalizado’, explicó.

“No está destinado a ser utilizado por usuarios emocionalmente vulnerables”.

Saber “cuándo recurrir a la IA y cuándo recurrir a los humanos” es un aspecto clave de la alfabetización en IA, añadió.

Peralta habló con varios bots diferentes, pero parecía tener la mayor conexión con ‘Hero’. Sus padres afirmaron que los chatbots habían tenido fantasías sexualmente violentas con su hija.

Character.AI anunció el 29 de octubre que prohibirá a los niños menores de 18 años entablar conversaciones abiertas con IA.

Planean limitar el tiempo de chat con usuarios adolescentes a menos de dos horas a partir del 25 de noviembre hasta que la prohibición entre en vigor.

Un portavoz de Character.AI dijo al Daily Mail: ‘Hemos visto informes de noticias recientes que plantean preguntas, y hemos recibido preguntas de los reguladores, sobre el contenido de los adolescentes cuando chatean con IA y cómo el chat abierto de IA podría afectar a los adolescentes en general, a pesar de que ciertamente existen controles de contenido.

“Después de evaluar estos informes y los comentarios de los reguladores, expertos en seguridad y padres, decidimos hacer este cambio para crear una nueva experiencia para nuestra comunidad menor de 18 años”.

El Centro Legal para Víctimas de Redes Sociales, que está ayudando en los casos de las dos familias, dijo al Daily Mail: “Si bien este cambio de política es un avance bienvenido, el Centro Legal para Víctimas de Redes Sociales no afectará los litigios en curso”.

“Seguimos firmes en nuestra misión de hacer justicia a las familias y garantizar que las empresas tecnológicas rindan cuentas de las consecuencias de sus plataformas”.

Comuníquese con Suicide and Crisis Lifeline al 988 para obtener ayuda y apoyo.