Joe KleinmanEditor de tecnología

bbc

bbcEstuve al final del muelle en Dorset en verano.

Dos de estas imágenes fueron creadas utilizando la herramienta de inteligencia artificial Grok, de uso gratuito y propiedad de Elon Musk.

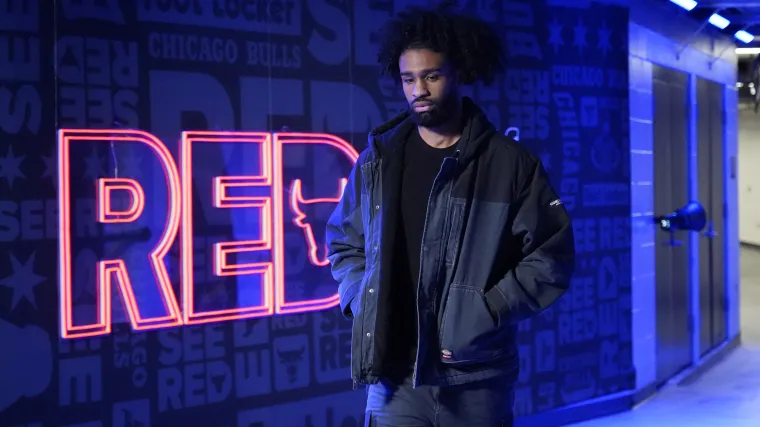

Es muy convincente. Nunca usé el traje de esquí amarillo ni la chaqueta roja y azul (la foto del medio es la original), pero debido a esas fotos no sé cómo podría demostrarlo si fuera necesario.

Sin embargo, en lugar de corregir a las mujeres, a Grock le prendieron fuego por desnudarlas. Y hacerlo sin su permiso.

Hacía fotografías de personas en bikini o cosas peores cuando otros se lo pedían. y compartió los resultados públicamente en la red social X.

También hay pistas que crea. Imágenes sexuales de niños..

Después de días de indignación y condena, Ofcom, el regulador online del Reino Unido, dijo que estaba investigando urgentemente. Si Grock violó o no las leyes británicas de seguridad en línea.

El Gobierno quiere que Ofcom avance… y rápido.

Sin embargo, Ofcom debe ser minucioso y seguir sus propios procesos si quiere evitar las críticas de un ataque a la libertad de expresión que ha perseguido la legislación de seguridad en línea desde sus primeras etapas.

Elon Musk ha estado inusualmente silencioso sobre el asunto en los últimos días, sugiriendo que también se da cuenta de lo grave que es esto.

Pero eliminó una publicación que acusaba al gobierno británico de buscar “cualquier excusa” para la censura.

En esta ocasión, no todos están de acuerdo en que la defensa sea aceptable.

“La IA que perfila a las personas en fotografías no es libertad de expresión, es abuso”, dijo el activista Ed Newton Rex.

“Cada foto que una mujer publica de sí misma en X genera inmediatamente respuestas públicas en las que aparece en bikini, algo está muy, muy mal”.

Teniendo en cuenta todo esto, la investigación de Ofcom podría llevar tiempo e implicar muchos intercambios, poniendo a prueba la paciencia de los políticos y el público.

No es sólo para Gran Bretaña Ley de seguridad en líneaPero también el regulador.

No puedo equivocarme.

Ofcom ha sido acusada de no tener dientes en el pasado. Esta ley, que tardó años en entrar en vigor, entró en vigor apenas el año pasado.

Hasta ahora ha impuesto tres multas relativamente pequeñas por incumplimiento, ninguna de las cuales ha sido pagada.

La Ley de Seguridad en Línea no aborda específicamente los productos de IA.

Si bien actualmente es ilegal compartir imágenes íntimas y no consensuadas, incluidos los deepfakes, no es ilegal pedirle a una herramienta de inteligencia artificial que las genere.

Eso está a punto de cambiar. Esta semana, el gobierno presentará una ley que ilegalizará la creación de estas imágenes.

Y el Reino Unido ha dicho que modificará otra ley (actualmente en el parlamento) que haría ilegal que las empresas suministren herramientas diseñadas para fabricarlas.

Si bien estas reglas existen desde hace un tiempo, en realidad no forman parte de la Ley de seguridad en línea, sino de una legislación completamente diferente llamada Ley de datos (uso y acceso).

El gobierno las ha anunciado varias veces durante varios meses, pero no se han implementado.

El anuncio de hoy muestra que el gobierno está decidido a sofocar las críticas de que la regulación avanza demasiado lentamente, demostrando que puede actuar rápidamente cuando así lo desee.

No es sólo Grok el que se ve afectado.

¿Una bomba política?

Una nueva ley que entrará en vigor esta semana podría convertirse en un dolor de cabeza para otros propietarios de herramientas de inteligencia artificial que sean técnicamente capaces de generar estas imágenes.

Y ya hay preguntas sobre cómo se implementará, algo que solo salió a la luz cuando Grok publicó su resultado en X.

Si un individuo utiliza una herramienta de forma privada, encuentra una manera de sortear las barreras de seguridad y el contenido resultante se comparte solo con aquellos que quieren verlo, ¿cómo sale eso a la luz?

Si se determina que X infringe la ley, Ofcom puede imponer una multa del 10% de sus ingresos mundiales o 18 millones de libras esterlinas, lo que sea mayor.

También puede intentar bloquear a Grok o X en el Reino Unido. Pero también puede ser una bomba política.

Me senté en la Cumbre de IA en París el año pasado y vi al vicepresidente JD Vance decir que los países extranjeros se estaban “hartando” del intento de la administración estadounidense de regular sus empresas de tecnología.

Su audiencia, que incluía a un gran número de líderes mundiales, permaneció sentada en un silencio sepulcral.

Pero las empresas tecnológicas tienen mucho poder de fuego dentro de la Casa Blanca, y muchas de ellas han invertido miles de millones de dólares en infraestructura de inteligencia artificial en el Reino Unido.

¿Puede el país romper con ellos?