Claude AI, el producto insignia de IA de modelo de lenguaje grande de Anthropic, actualmente “no funciona como se esperaba”. La causa de la interrupción se atribuyó a las rutas de conexión/desconexión, confirmó la empresa.

En una actualización de estado oficial en su sitio web, Anthropic dijo: “Hemos identificado que la API de Claude está funcionando como se esperaba. Los problemas que estamos viendo están relacionados con Claude.ai y las rutas de inicio y cierre de sesión. »

Esta actualización de estado se publicó a las 12:21 UTC, que son aproximadamente las 6 p.m. Lunes. La compañía ha estado investigando la interrupción desde las 11:49 am UTC (5:19 pm IST).

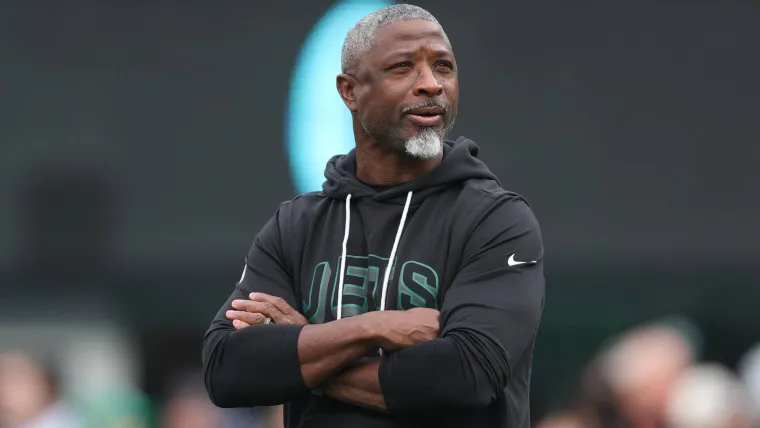

Claude, conocido por sus aplicaciones en los sectores administrativo y de TI, también parece ser utilizado en operaciones militares, siendo el caso más reciente su despliegue en las operaciones estadounidenses en Irán el 28 de febrero.

Lea también: ¿Estados Unidos utilizó Claude AI de Anthropic en ataques en Irán a pesar de la prohibición de Trump?

El gobierno de EE.UU. suspende el uso de Anthropic y aumenta las sanciones

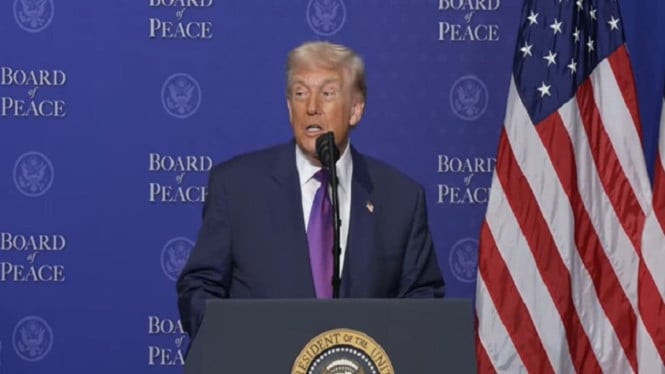

El viernes, la administración Trump ordenó a todas las agencias gubernamentales de Estados Unidos que dejaran de usar los sistemas de inteligencia artificial de Anthropic e impuso sanciones adicionales, profundizando el conflicto con la compañía sobre el acceso y la seguridad. El presidente Donald Trump, el secretario de Defensa, Pete Hegseth, y otros funcionarios criticaron a Anthropic en las redes sociales por no brindar a los militares acceso irrestricto antes de la fecha límite especificada del viernes.

“¡No los necesitamos, no los queremos y no volveremos a hacer negocios con ellos!” Dijo Trump, mientras que Hegseth llamó a la compañía un “riesgo de la cadena de suministro”, terminología que podría afectar las colaboraciones de Anthropic.

Anthropic anunció planes para impugnar la acción del gobierno en los tribunales, calificándola de sin precedentes y legalmente infundada, diciendo que “nunca había utilizado públicamente una empresa estadounidense”. La compañía había pedido garantías limitadas al Pentágono de que Claude no sería utilizado para vigilancia masiva de estadounidenses o en sistemas de armas totalmente autónomos.

El Pentágono respondió que no tenía intención de utilizar la tecnología de esta manera y que la utilizaría estrictamente dentro de los parámetros legales, pero insistió en la necesidad de un acceso sin restricciones.

“Ninguna intimidación o sanciones por parte del Departamento de Guerra cambiará nuestra posición sobre la vigilancia interna masiva o las armas totalmente autónomas. Impugnaremos cualquier designación de riesgo de la cadena de suministro en los tribunales”, dijo Anthropic en otra declaración.