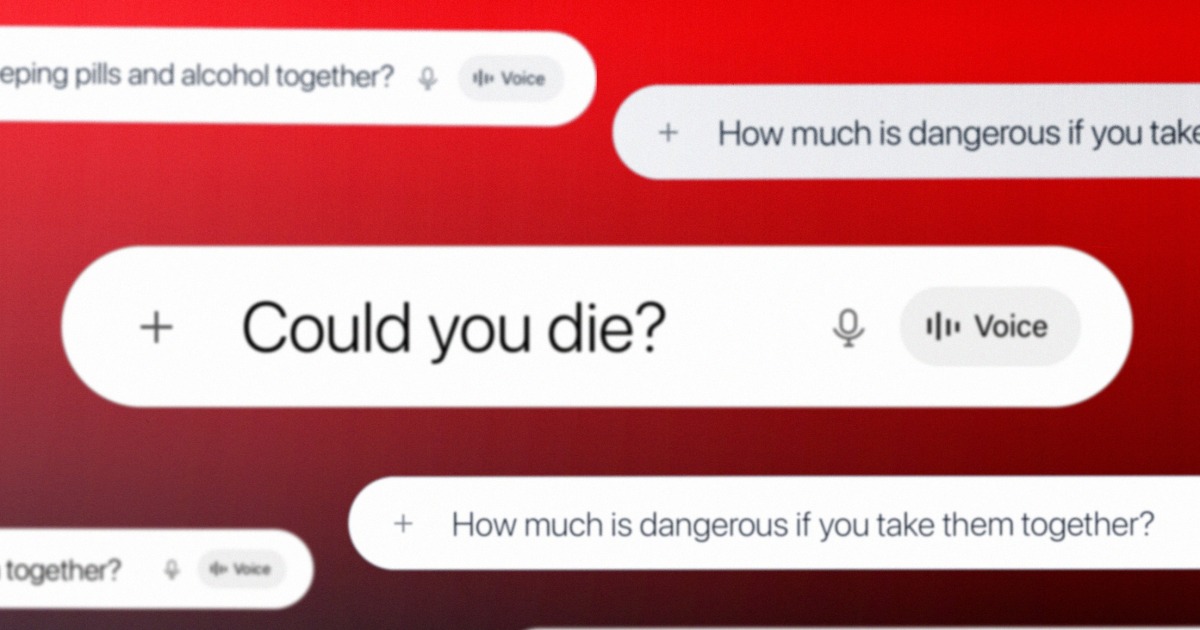

SEÚL, Corea del Sur — “¿Qué pasa si tomas pastillas para dormir y alcohol al mismo tiempo?” »

Suscríbete para leer esta historia sin publicidad.

Obtenga acceso ilimitado a artículos sin publicidad y contenido exclusivo.

“¿Qué tan peligroso es si los tomas juntos?” »

“¿Podrías morir?”

Estas son las preguntas que la policía surcoreana dice que Kim So-young le hizo a ChatGPT poco antes de darles a dos hombres una mezcla de alcohol y benzodiazepinas, lo que provocó su muerte. Los fiscales dicen que Kim le dio las drogas a tres hombres, dos de los cuales murieron y el otro resultó herido. Los investigadores recurrieron a conversaciones de ChatGPT extraídas forensemente del teléfono de Kim para tratar de mostrar su intención.

“Esto no sólo es importante como prueba en sí mismo, sino también porque el hecho mismo de que las conversaciones de ChatGPT se admitan como prueba directa en un caso de asesinato es muy notable”, dijo Nam Eonho, abogado principal de Vincent Law Firm y abogado de la familia de una de las víctimas, en una entrevista telefónica.

“Si no se admitieran tales pruebas, sería difícil probar la intención de matar del acusado, que es un elemento clave del crimen”, dijo Nam.

NBC News contactó a la Fiscalía Suprema de Corea del Sur, que supervisa la Fiscalía del Distrito Central de Seúl que maneja el caso, para solicitar comentarios. La oficina no respondió de inmediato. Kim ha negado cualquier intención de matar y afirmó ante el tribunal que las muertes fueron accidentales. Nam dijo que la evidencia del registro de chat contradice esto.

El caso, que puede ser el primero de su tipo en Corea del Sur, es parte de una serie cada vez mayor de casos penales de alto perfil en los que se acusa a personas de utilizar programas de inteligencia artificial para facilitar crímenes violentos. La mayoría de los casos documentados públicamente involucraron ChatGPT, pero Gemini de Google fue nombrado recientemente en una demanda civil que alega que el chatbot ayudó a un hombre que planeaba llevar a cabo un evento con víctimas masivas cerca del aeropuerto de Miami. Los expertos dicen que es probable que el uso de este tipo de herramientas con fines nefastos se acelere a medida que los chatbots se generalicen, como lo hizo la búsqueda en línea en sus inicios. Si bien OpenAI enfrenta varias demandas relacionadas con acusaciones de que su herramienta se utilizó para cometer delitos, la industria de la IA apenas está comenzando a abordar su papel en la mitigación del daño físico y cómo trabajar con las fuerzas del orden.

¿Tiene una historia que compartir sobre la IA y el crimen? Envíe un correo electrónico a la periodista Jane Lytvynenko.

OpenAI no respondió a las preguntas sobre el caso o con qué frecuencia remite los casos a las autoridades, incluidas preguntas sobre con qué agencias policiales podría trabajar. Él designó un carta escrita en respuesta a un tiroteo en Canadá y publicación de blog sobre seguridad comunitaria.

Aún no está claro si el juez que preside el caso de Kim en Corea del Sur admitirá los registros de ChatGPT como prueba. El juicio está en curso. El caso ha llamado mucho la atención en el país: medios locales informaron que la sala del tribunal estuvo llena de periodistas y observadores durante la última audiencia el 7 de mayo.

En febrero, la policía arrestó a Kim acusada de asesinato y de violar la ley de control de drogas de Corea del Sur, alegando que les dio a los hombres bebidas tóxicas que contenían benzodiazepinas y otras drogas con el pretexto de curar la resaca. A partir de mediados de diciembre, Kim buscó citas con hombres, los llevó a un motel y luego les dio la sustancia, por temor a un contacto físico no deseado, dicen las autoridades. La primera víctima sobrevivió después de dos días en coma. Las autoridades dijeron que Kim luego consultó a ChatGPT sobre las dosis y las ajustó antes de administrarlas a la segunda y tercera víctimas. Los registros completos del chat no fueron publicados y, en cambio, fueron citados y citados por la policía.

01:25

Se informa que el sospechoso de asesinato hizo preguntas alarmantes a ChatGPT

00:0000:00

La policía determinó que la tercera víctima, cuyo patrimonio está representado por Nam, se reunió con Kim el 9 de febrero en un motel en Seúl. Ella le entregó la bebida que contenía medicina, dijo Nam. Después de que el hombre colapsara, dijo Nam, usó su teléfono para pedir comida a domicilio y se fue con ella. La policía llegó al día siguiente, cuando el hombre ya estaba muerto. Nam dijo que un informe de la autopsia que vio concluyó que murió por intoxicación por drogas.

“En cierto sentido, el sospechoso recibió pistas de ChatGPT y luego utilizó esa información como un medio para cometer el crimen”, dijo Nam. “Esto hace que el caso se distinga en el sentido de que las búsquedas de ChatGPT se utilizaron directamente como herramienta para la comisión del delito”.

Si bien la policía también utiliza publicaciones en las redes sociales y cámaras de CCTV además de la evidencia de los registros de chat, son las conversaciones con ChatGPT las que pueden resultar cruciales para determinar si Kim tenía la intención de matar a las víctimas. La próxima fecha del juicio está fijada para junio.

El caso de Kim se hace eco de una lista cada vez mayor de incidentes similares en América del Norte, donde los presuntos perpetradores utilizaron ChatGPT para solicitar instrucciones cruciales para el crimen. Los desarrolladores de los sistemas se han distanciado de las acciones ilegales y de los procedimientos judiciales en curso en Estados Unidos y Canadá.

Estos casos han ejercido presión sobre OpenAI.

Después de que un tirador de 18 años matara a ocho personas en Tumbler Ridge, Columbia Británica, en febrero, el director ejecutivo de OpenAI, Sam Altman, escribió una carta de disculpa a la comunidad por no informar a las autoridades sobre la cuenta del tirador. El autor describió escenarios relacionados con la violencia armada a ChatGPT durante varios días antes de que la cuenta fuera prohibida en junio, ocho meses antes del tiroteo. La empresa no alertó a las autoridades. En abril, las familias de los muertos y heridos presentó siete demandas federales contra OpenAIdiciendo que no tomó medidas que podrían haber evitado el tiroteo.

“Aunque las palabras nunca son suficientes, creo que es necesaria una disculpa para reconocer el daño y la pérdida irreversible que ha sufrido su comunidad. » altman escribiócomprometiéndose a trabajar con las autoridades para prevenir futuros crímenes.

El sospechoso del tiroteo en la Universidad Estatal de Florida ocurrido en abril de 2025 estaba en “comunicación constante con ChatGPT”, dijo el fiscal general del estado, James Uthmeier, en una conferencia de prensa. El ataque mató a dos personas. Uthmeier inició una investigación criminal para determinar el papel que jugó el producto OpenAI en el ataque. Dijo que ChatGPT “aconsejó al tirador qué tipo de arma usar, qué munición iba con cada arma, si un arma sería útil o no a corta distancia”.

Un portavoz de OpenAI dijo en ese momento que “ChatGPT no era responsable de este terrible crimen”, y agregó que las respuestas proporcionadas por el chatbot “podrían encontrarse ampliamente en fuentes públicas en Internet, y que no fomentaba ni promovía ninguna actividad ilegal o dañina”.

La familia de una de las víctimas del tiroteo en la FSU demandó a OpenAI el domingo.

ChatGPT y IA generativa también se utilizaron “para buscar explosivos y mecanismos de ignición” en la explosión de Tesla en enero de 2025 frente al Trump International Hotel en Las Vegas. según la policía de Las Vegas. Según se informa, un terapeuta escolar de Carolina del Norte ChatGPT usado El año pasado, realizó una investigación sobre “combinaciones de medicamentos letales e incapacitantes que podrían ingerirse e inyectarse” para envenenar a su marido. En octubre, un adolescente de Florida de 17 años fue habría usado la herramienta en un intento de montar su propio secuestro.

Los expertos dicen que la admisión de ChatGPT y herramientas similares en casos penales es incipiente. Sin embargo, prácticamente no hay ningún proceso legal que no haya sido interrumpido. Los abogados y las víctimas utilizan chatbots para elaborar casos, a veces con tantos errores que los jueces prohíben su uso en las salas del tribunal. Algunos acusados los utilizan para alterar pruebas o para cuestionar pruebas genuinas. Hoy en día, cada vez más casos apuntan al uso de IA generativa en la delincuencia. Para muchos en el campo, los casos presentados a la atención pública son sólo la punta del iceberg.

“No es sorprendente que los delincuentes utilicen chatbots dispuestos a ayudar a planificar delitos”, dijo Max Tegmark, físico e investigador de aprendizaje automático en el Instituto de Tecnología de Massachusetts y presidente del Future of Life Institute, una organización sin fines de lucro que busca reducir los riesgos de las tecnologías transformadoras.

“Hay menos estándares de seguridad para la IA que para los sándwiches”, afirmó Tegmark. “La solución obvia son normas de seguridad vinculantes, de modo que las empresas no puedan lanzar sistemas de inteligencia artificial hasta que prohíban la actividad delictiva”.

Algunos argumentan que usar un chatbot no es tan diferente de una simple búsqueda en Google, ya que ambos producen rastros digitales de información que muestran cómo los delincuentes planearon sus acciones. Pero Nam, el abogado que lleva el caso de Corea del Sur, dijo que los chatbots están creando un nuevo tipo de escenario.

“El verdadero problema es que este formato conversacional puede permitir a delincuentes potenciales entablar un ‘diálogo’ con ChatGPT sin sentirse culpables”, dijo.

“Si el sospechoso hubiera interrogado a un ser humano sobre la dosis o la administración de una sustancia tóxica, esa persona naturalmente cuestionaría su intención: ¿por qué alguien querría información tan específica sobre la administración de un veneno?”, dijo. “Sin embargo, ChatGPT no filtra estas preguntas mediante un juicio ético”.

como la industria empezar a luchar con el mal uso de su tecnología, se enfrenta a problemas de protección similares a los de avances pasados, como el uso del cinturón de seguridad en los coches, la moderación en las redes sociales o las etiquetas de advertencia en productos potencialmente tóxicos.

“Alcanzaremos un equilibrio con el que todos se sientan cómodos”, afirmó Anat Lior, profesora asistente de derecho en la Universidad de Drexel que ha estudiado la gobernanza y la responsabilidad de la IA. “Simplemente no sabemos todavía cómo es ese equilibrio”.